展望前路

迈向全自主自动驾驶汽车

尽管这些技术进步尚未彻底将人类从驾驶座上解放出来,但它们可以挽救生命。美国国家公路交通安全管理局的最新数据显示,2018 年,美国有近 36,000 人死于交通事故,其中超过 90% 的事故是由人为失误造成。过去十年中,行人死亡人数增加了 35%,达到了每年逾 6,000 人。车辆感知技术可以比人类更好地“观察”周围环境,并能更快地做出反应,从而显著减少人员伤亡。

人们一致认为感知技术将超越人类观察和感知驾驶环境的能力,但在更具体的方面则各执己见。对于究竟哪项技术将引领我们进入无人驾驶汽车时代,汽车行业尚未达成共识。事实上,最终解决方案需要的技术可能不止一种。下面,我们将走近三家技术公司,了解他们如何积极推进汽车感知技术、致力迈向全自主自动驾驶汽车的未来。

“我们专注于远程和高分辨率,这是汽车雷达中最难解决的问题。”

波束控制雷达

早在 20 世纪初,人们就开始将雷达用于船只和飞机导航。雷达可以在复杂条件下检测和识别目标并提供准确的速度信息,这使其成为自主驾驶的理想选择。

加利福尼亚 Metawave 公司的工程师们正在挑战雷达的极限,使之能够在各种天气条件下和在黑夜中识别其他汽车、行人、周围的静止物体、道路危险等更多信息。该公司的模拟雷达平台 SPEKTRA™ 可形成窄波束并控制波束转向,只需几毫秒即可对目标进行检测和分类。Metawave 的工程总监 Abdullah Zaidi 表示,该平台拥有汽车行业分辨率最高的模拟雷达技术。该技术可以看到 250 米外的行人并识别 330 米外的车辆。

另外,该平台还可以准确测量两个目标之间的微小距离,称为角分辨率,这使雷达能够区分不同的目标。Zaidi 表示:“这是目前的雷达无法做到的。”

Metawave 利用机器学习和 AI 构建模拟波束控制雷达系统。图片所有权:Metawave 公司

SPEKTRA 扫描环境的方式也十分独特。不同于传统的数字雷达系统一次捕获所有信息(类似于一个强大的闪光灯照亮整个场景),Metawave 雷达的工作方式更像激光束,一次只能看到一个特定的空间区域。光束快速扫过周围环境,在几毫秒内对车辆视野内的所有目标进行检测和分类。Metawave 的方法提高了感知范围和精度,同时减少了干扰和杂波的概率,而所有这些只需要很少的计算开销。Zaidi 表示:“我们专注于远程和高分辨率,这是当今汽车雷达中最难解决的问题。”

Metawave 工程师使用 MATLAB® 测试 SPEKTRA 雷达的范围和分辨率,并创建处理雷达输出的底层算法。这项技术赋予汽车自动驾驶功能,例如左转辅助、盲点监控、自动紧急制动、自适应巡航控制和车道辅助。

更智能的激光雷达

一些最早的自动驾驶汽车(在由美国国防高级研究计划局 (DARPA) 赞助的一项比赛中研发)使用基于激光的系统来“观察”环境。光检测和测距(激光雷达)传感系统每秒发射数千个光脉冲,在击中周围的物体后反射回汽车。在此基础上,计算机使用每个数据点(称为“体素”)来重建环境的三维图像,并最终控制汽车的移动方式。

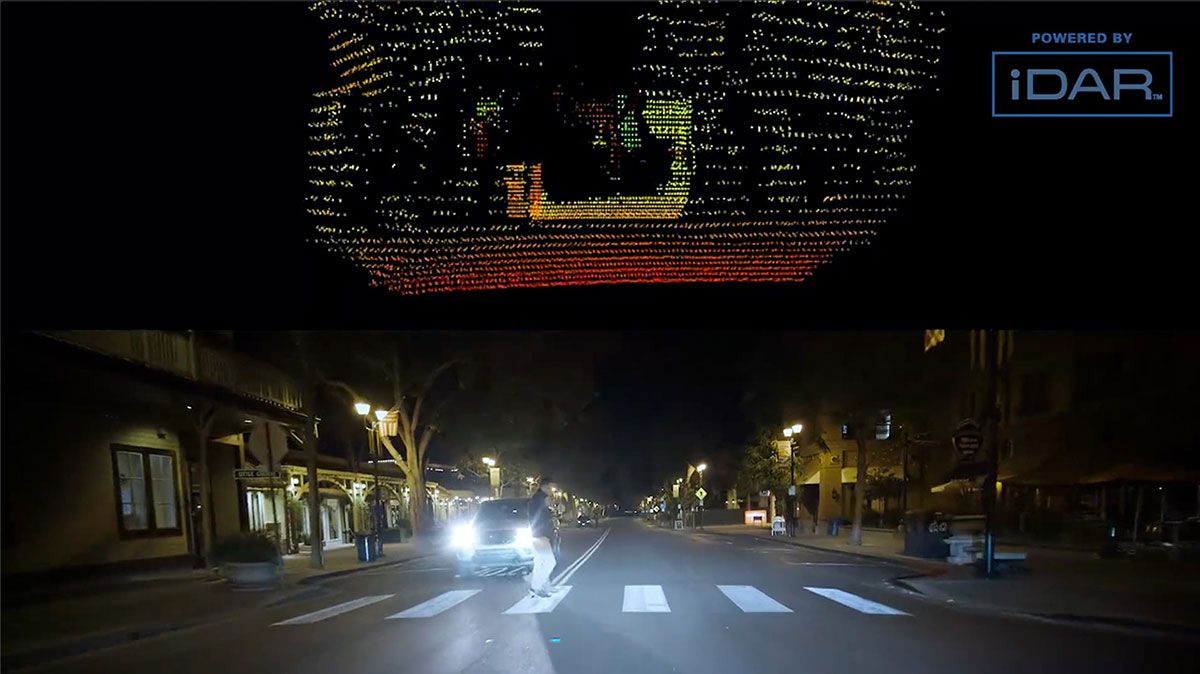

iDAR 将航空航天和国防工业中的强大传感功能带入了汽车市场。图片所有权:AEye, Inc.

然而,激光雷达非常昂贵,每辆车的应用成本超过 70,000 美元。此外,单纯依赖激光雷达也有其局限性。恶劣的天气会干扰信号,因此这项技术通常与其他传感技术结合使用,例如摄像头、雷达或超声波。但这会产生大量冗余和无关信息,而中央计算机又不得不加以解析——正如总部位于加利福尼亚都柏林的 AEye 联合创始人兼高级副总裁 Barry Behnken 所言。

“我们的最终目标是开发一种能力与人类相当甚至较之更强的感知系统。”

该公司的工程师将激光雷达与高分辨率摄像机融合,从而增强了激光雷达的能力。该系统名为 iDAR(智能检测和测距),可生成一种新型的数据点,它将数码摄像头的高分辨率像素与激光雷达的三维体素整合在一起。他们将这些数据点称为“Dynamic Vixels”。由于激光脉冲和摄像机通过同一孔径采集光学信息,因此可以将数据流集成并同时进行分析,从而节省了时间并减少了处理工作。

iDAR 并不像传统激光雷达系统那样均匀地扫描整个场景,而是会调整其光脉冲模式以更多地关注场景的关键区域。激光脉冲的方向由 AEye 的计算机视觉算法决定。算法首先分析摄像头数据以搜索和检测目标的边缘,然后立即用更高分辨率的激光雷达对准扫描,以分类、跟踪这些目标并预测其移动。工程师使用 MATLAB 以确保算法能够以最佳、最高效的光脉冲模式扫描场景。

Behnken 表示:“我们正尝试在传感器端增加类似的感知功能,以减少车辆中央计算端的负荷。”他谈到,更快地捕捉更优质的信息可以提高感知准确度,同时比传统的解决方案耗费更少的激光功率。他表示:“我们的最终目标是开发一种能力与人类相当甚至较之更强的感知系统。”

iDAR 在运动目标周围有针对性地 地分配额外的激光雷达达脉冲,从而对这些目标进行分类,并计算其方向和速度。图片所有权:AEye, Inc.

热波

激光雷达、雷达和摄像机技术的进步都将帮助自主驾驶技术走向未来。但没有一种传感器能够单独完成这项任务。总部位于纽约费尔波特的Owl Autonomous Imaging 公司副总裁兼首席技术官 Gene Petilli 表示:“它们都有各自的优点和缺点。”

Petilli 谈到,传统的激光雷达非常精确,但雪、雨和雾降低了它分辨有生命目标和无生命目标的能力。另一方面,传统的雷达不受雪的阻碍,在远距离时表现出色,并且可以判断目标的相对速度,但仅靠雷达自身无法区分这些目标是什么。摄像头可以识别交通信号灯和路牌,但眩光会影响质量,而到了晚上,它们只能看到前大灯照亮的地方。

原型 Owl AI 的热成像。 观看原型系统的完整视频. 。视频所有权:Owl Autonomous Imaging

“自主汽车只有比人类驾驶员更安全,才会被大众所接受。”

Petilli 表示:“秘诀是选择一组没有相同弱点的传感器。”

Owl AI 的团队利用三维热成像技术填补了这一空白,该技术可以感知人和动物发出的热信号,极大地简化了目标分类。该公司的 Thermal Ranging™ 传感器是一种被动系统(这意味着传感器无需发出能量或光,只需等待接收反射回来的能量或光),它可以捕捉有生命目标的红外热。无论白天或黑夜、天气如何、目标移动还是静止,该传感器都能看到 400 米范围内的目标,并且可以计算出 100 米范围内目标的速度及其占据的三维范围。

这款设备包括一个主透镜,类似于普通摄像头中的镜头,外加位于主透镜和检测器之间的非常小的透镜阵列。这组阵列将场景细分成多个图像,每个图像以不同的角度呈现关注目标。设备算法通过测量图像之间的细微差别来计算与目标之间的距离。

Petilli 表示,公司正在使用 MATLAB 来完善这个系统。因为需要测量微透镜阵列中元素之间的微小差异,因此任何透镜畸变都会导致距离计算发生误差。所以,他们在 MATLAB 中对整个系统进行建模,以完善透镜畸变校正算法。此外,他们还运行了驾驶仿真,以训练生成三维热图像的深度神经网络 AI 算法。他们将利用深度学习评估神经网络算法,以将细分图像转换为三维地图。

Petilli 表示:“自主驾驶汽车只有比人类驾驶员更安全,才会被大众所接受。”

加强安全性

车辆感知技术是提供安全的自动驾驶体验的关键。为了实现全自主自动驾驶汽车的承诺,科技公司正在利用 AI 和计算机视觉来帮助汽车观察和感知周围的环境。尽管全自主汽车还不是常态,但在这些公司不断完善当前新车安全系统的过程中,我们得以走近这一未来愿景。