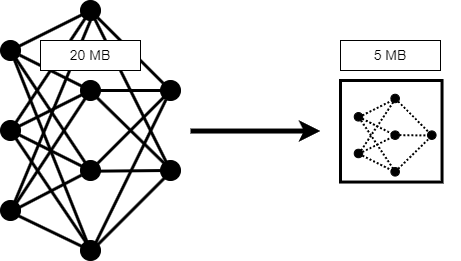

剪枝、投影和量化

压缩深度神经网络,减少网络内存占用,并为生成代码准备网络

将 Deep Learning Toolbox™ 与 Deep Learning Toolbox Model Compression Library 支持包结合使用,以减少深度神经网络的内存占用和计算要求:

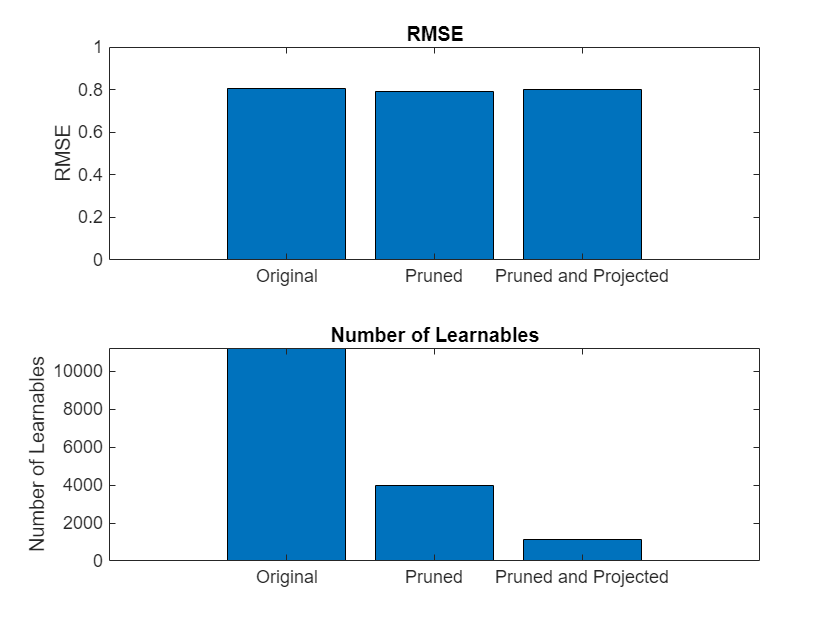

使用一阶泰勒逼近从卷积层中对滤波器进行剪枝。

通过对层激活执行主成分分析 (PCA) 来对层进行投影。

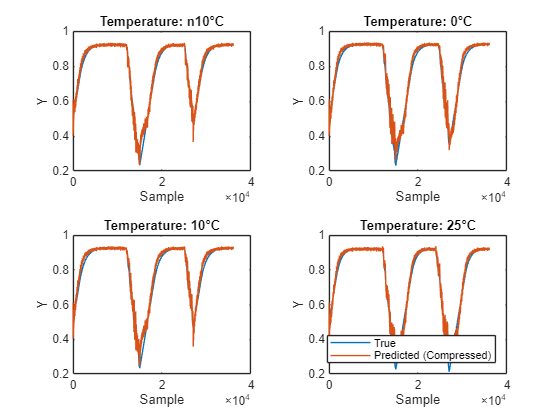

将层的权重、偏置和激活量化为精度降低的缩放整数数据类型。

然后,您可以从压缩后的网络生成代码,并将其部署到所需的硬件。