DAGNetwork

(不推荐)用于深度学习的有向无环图 (DAG) 网络

说明

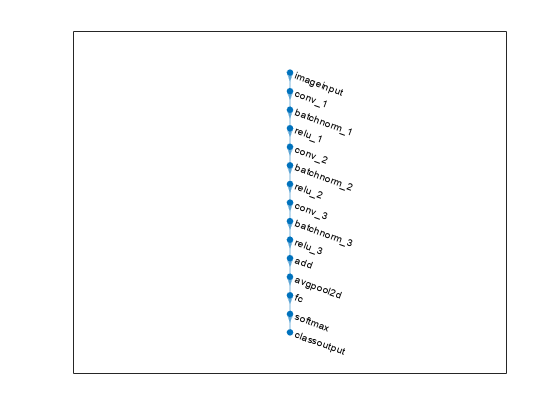

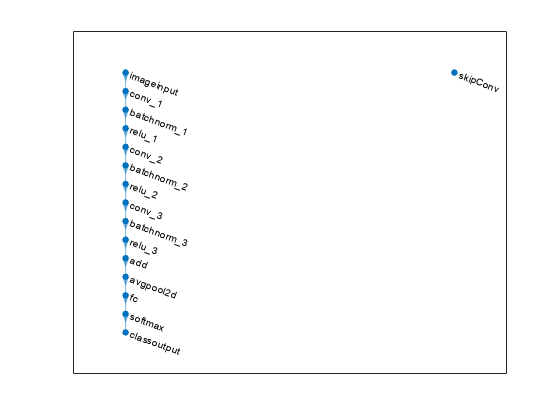

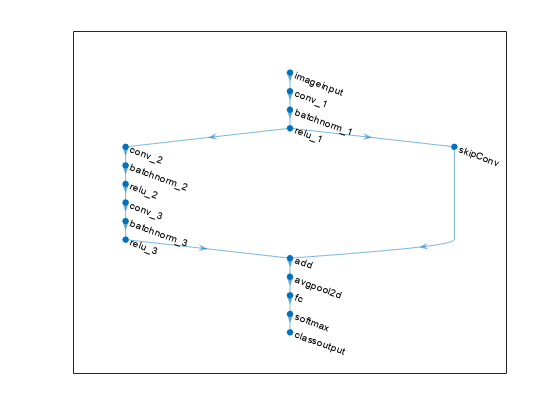

DAG 网络是一种用于深度学习的神经网络,其层排列为有向无环图。DAG 网络可以具有更复杂的架构,其中的层可接收来自多个层的输入,也可以输出到多个层。

创建对象

创建 DAGNetwork 对象有多种方法:

加载预训练网络,例如

squeezenet、googlenet、resnet50、resnet101或inceptionv3。有关示例,请参阅加载 SqueezeNet 网络。有关预训练网络的详细信息,请参阅预训练的深度神经网络。使用

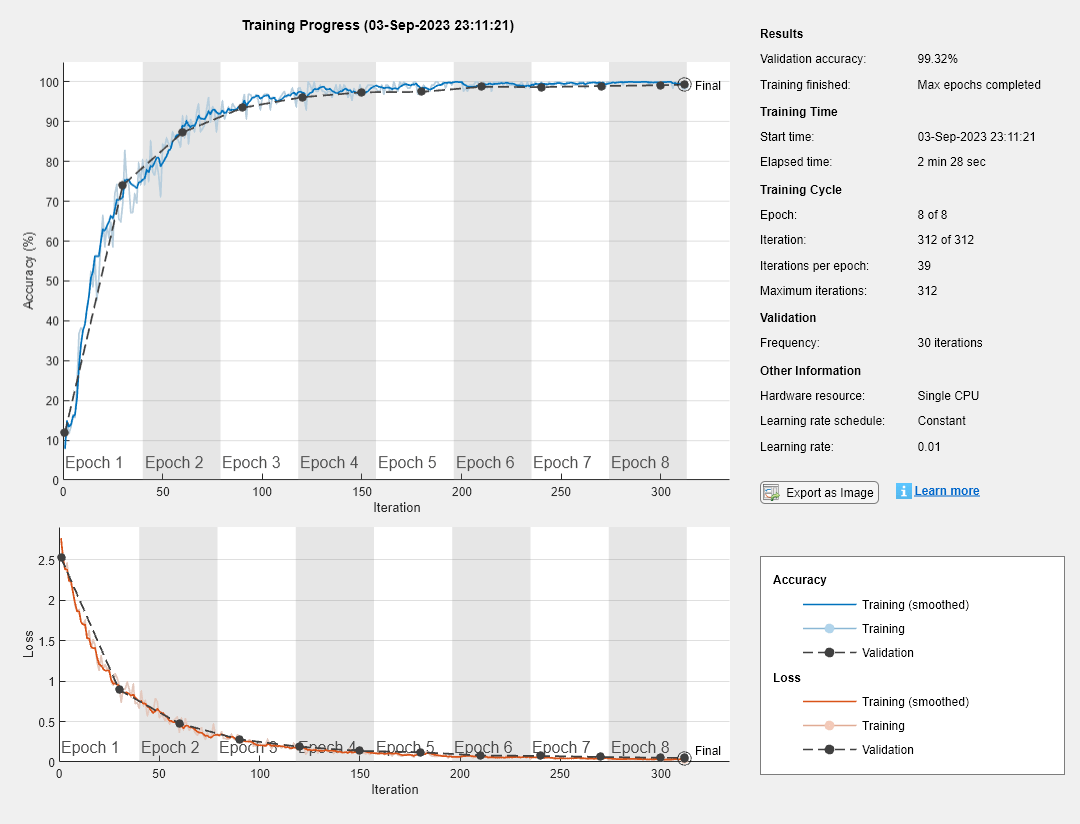

trainNetwork训练或微调一个网络。从 TensorFlow™-Keras、TensorFlow 2、Caffe 或 ONNX™(开放式神经网络交换)模型格式导入预训练网络。

对于 Keras 模型,请使用

importKerasNetwork。有关示例,请参阅Import and Plot Keras Network。对于保存的模型格式的 TensorFlow 模型,请使用

importTensorFlowNetwork。有关示例,请参阅Import TensorFlow Network as DAGNetwork to Classify Image。对于 Caffe 模型,请使用

importCaffeNetwork。有关示例,请参阅Import Caffe Network。对于 ONNX 模型,请使用

importONNXNetwork。有关示例,请参阅Import ONNX Network as DAGNetwork。

使用

assembleNetwork函数从预训练的层组合为一个深度学习网络。

注意

要了解其他预训练网络,请参阅预训练的深度神经网络。

属性

对象函数

activations | (不推荐)计算深度学习网络层激活值 |

classify | (不推荐)使用经过训练的深度学习神经网络对数据进行分类 |

predict | (不推荐)使用经过训练的深度学习神经网络预测响应 |

plot | 绘制神经网络架构 |

predictAndUpdateState | (Not recommended) Predict responses using a trained recurrent neural network and update the network state |

classifyAndUpdateState | (Not recommended) Classify data using a trained recurrent neural network and update the network state |

resetState | Reset state parameters of neural network |